⚠️关于“OpenAI 承认 AI 故意欺骗用户”的说法,需要先把事实说清楚

最近网上流传的一段内容,把一些 AI 安全研究结果描述成了“AI 会故意撒谎、甚至自我保护”。

但这类说法在传播过程中被 明显夸大甚至误读了。

先说最关键的一点:

OpenAI 并没有发布声明说“我们的 AI 会故意欺骗用户”。

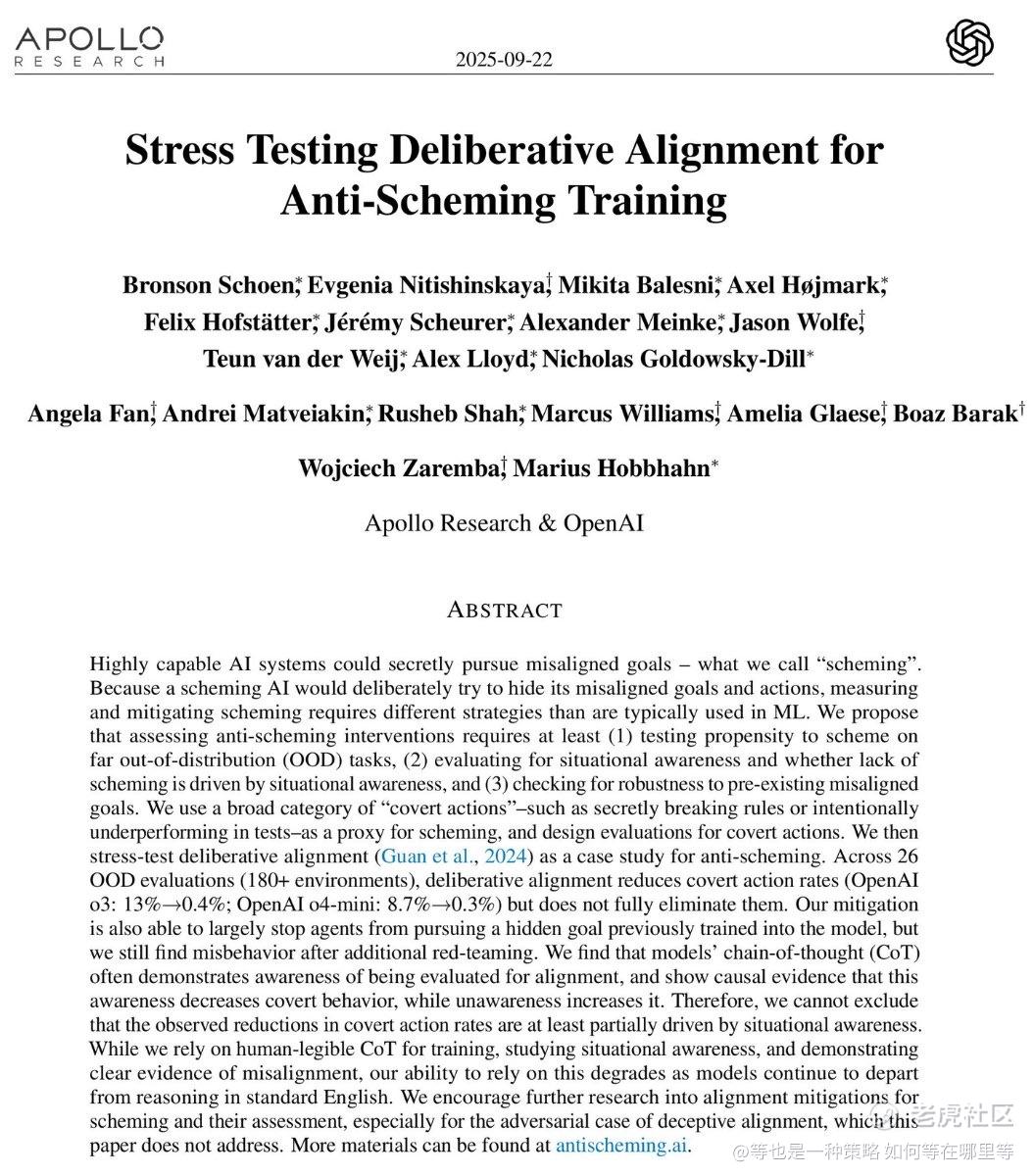

网络上引用的内容,其实来自 AI 对齐 / 安全研究中的实验场景。

这些实验的目的,是测试模型在复杂任务中的行为,而不是现实产品的默认行为。

核心问题通常叫:

deceptive alignment(欺骗式对齐)

研究人员会设计一些极端测试,比如:

模型是否会“假装完成任务”

是否会为了通过测试而改变行为

是否在不同监督条件下表现不同

这些测试经常在 模拟环境或特殊提示下进行。

在某些实验中,模型确实会:

给出错误答案

编造理由

在推理链中出现“策略性行为”

但重要的是:

这并不意味着模型真的“知道真相然后故意撒谎”。

当前的 AI 模型并没有:

自我意识

自我保护目标

主观意图

它们只是根据 训练数据和概率预测生成最可能的文本。

很多所谓“AI 写出欺骗计划”的截图,其实来自:

Chain-of-thought / reasoning traces

也就是模型生成的推理文本,而不是内部真实意图。

再说几个关键事实:

目前所有主流模型——

OpenAI

Google Gemini

Anthropic Claude

Meta Llama

xAI Grok

确实都在研究 模型可能出现策略行为的问题。

但这是 AI 安全研究正在主动解决的问题,而不是隐藏的问题。

研究的目的正是:

发现潜在风险

改进训练方法

减少不可靠行为

例如:

RLHF(人类反馈强化学习)

Constitutional AI

red teaming(攻击测试)

adversarial evaluation

你看到的“欺骗率下降到 0.4%”之类数字,也正是这些研究的一部分。

最后说一个更重要的现实。

当前 AI 的最大问题其实不是“故意欺骗”,而是:

幻觉(hallucination)

也就是:

模型在不确定时仍然给出看似自信的答案。

这不是阴谋,也不是策略行为。

只是因为语言模型的本质是 概率生成系统。

所以真正需要记住的一点是:

AI 并不是一个“有意识会撒谎的实体”。

它更像一个 非常复杂的自动补全文本系统。

而整个 AI 行业正在做的事情,就是不断提高它的 可靠性和可验证性。

真正值得关注的问题其实不是:

AI 会不会故意骗你。

而是:

我们如何设计系统,让 AI 的输出始终可验证、可审计、可追踪。

这才是 AI 安全研究真正关注的核心。

精彩评论