Agentic AI 的兴起,正在悄然改变 AI 基础设施的核心逻辑。过去两年,市场几乎形成了单一共识:算力的瓶颈在 GPU,谁掌握高端 GPU,谁就掌握 AI 时代的入口。但随着 Agent 架构逐渐落地,这一判断开始出现偏差。AI 系统不再只是“算一次模型”的问题,而是变成一个由多个子任务、工具调用和多轮决策组成的复杂流程。在这个过程中,真正承担调度、编排和执行逻辑的,不是 GPU,而是 CPU。

这种变化首先体现在系统结构上。传统的大模型推理以 GPU 为中心,CPU主要负责数据搬运和简单控制;而在 Agent 模式下,一个请求往往会被拆解为多个步骤,例如任务规划、工具调用、结果整合等,每一步都依赖 CPU 进行调度和决策。结果是,整体系统的延迟中,CPU 所占的比重显著上升,甚至在某些场景中超过 GPU。换句话说,GPU 的计算能力并没有下降,但它开始受到 CPU 调度能力的限制,出现“等数据、等任务”的情况。

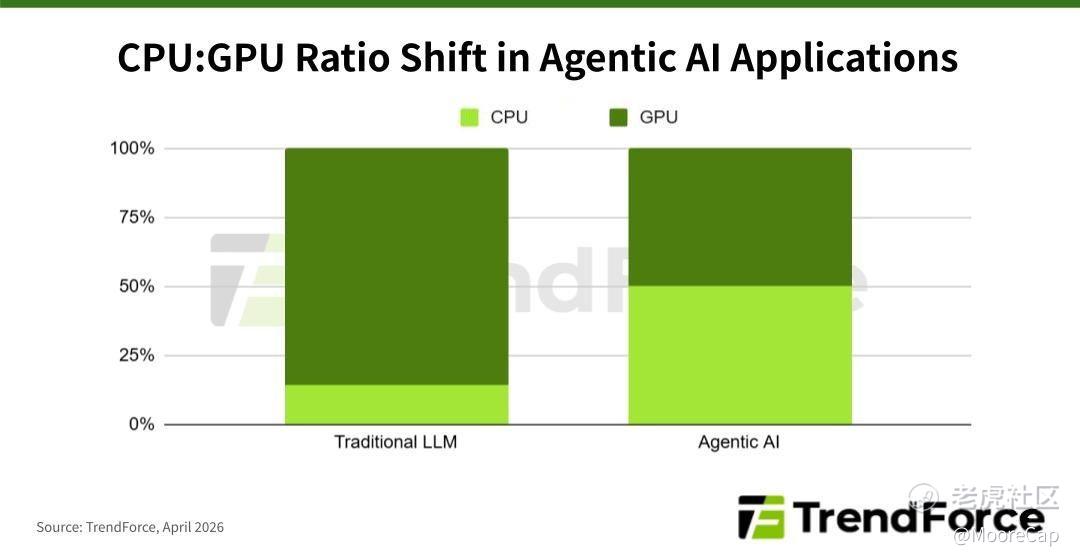

随之而来的,是硬件需求结构的变化。为了避免 GPU 利用率下降,系统必须增加 CPU 配置,提高并发调度能力,这直接推高了 CPU 在服务器中的占比。过去以 GPU 为核心的配置逻辑,正在向更加均衡的异构架构转变。云厂商和芯片公司已经开始做出调整,从单纯堆叠 GPU,转向优化 CPU、GPU 与网络之间的协同效率。一些厂商甚至重新强调 CPU 的战略地位,将其视为 AI 基础设施中的“操作系统层”。

这一变化正在通过市场信号逐步体现出来。服务器 CPU 的需求开始收紧,交付周期拉长,价格也出现上行趋势。与此同时,厂商的产品路线也在发生转向,不再只围绕 GPU 做性能竞争,而是强化整机层面的能力,包括 CPU 架构设计、系统集成以及调度效率优化。这些信号说明,算力瓶颈并没有消失,而是在基础设施内部发生了转移。

从投资角度看,这意味着过去依赖 GPU 单一逻辑的叙事正在失效。AI 产业链的关键环节正在扩散,从计算芯片延伸到调度芯片、系统设计乃至整机能力。未来一段时间内,真正决定算力效率的,不只是单点性能,而是整个系统的协同水平。谁能在 CPU、GPU 和网络之间建立更高效的配合机制,谁就更有可能在下一轮竞争中占据优势。

更重要的是,这种转变改变了对“算力”的理解。AI 不再只是计算密集型问题,而逐渐演变为调度密集型问题。随着 Agent 形态的普及,这种趋势只会进一步强化。对市场而言,这既是风险也是机会:风险在于旧有认知可能失效,机会在于新的瓶颈正在形成,而新的瓶颈,往往就是下一轮定价权的起点。

精彩评论