Will的AI伦理漫谈 | AI Killer:到底谁杀死了哈梅内伊?

想象这样一个场景:2026年初,一架无人机正在德黑兰上空飞行。它的传感器锁定了目标,它的算法在毫秒间完成了威胁评估,它的执行系统随之作出了决定。没有人下令。没有人预见到这个具体的结果。没有人在那一刻按下任何按钮。

目标死了。谁来负责?

这个问题,是近期围绕伊朗战争中AI武器角色争论的核心。互联网上广泛流传的文章声称,Claude和Palantir共同完成了"历史上第一次AI主导的杀伤链";但随即又有文章逐条纠错,指出爆款叙事中的物理谬误和逻辑漏洞。

两篇文章都值得认真对待——但它们争论的是事实层面的问题,而本文想追问的,是隐藏在事实争论背后的结构性伦理困境:

当AI深度嵌入战争决策链,"负责任"这三个字,是否已经在结构上失去了容身之处?

被遮蔽的真正问题

关于哈梅内伊之死,目前可以确认的事实是:

Claude曾被前线指挥官用于情报处理,尽管特朗普在行动前数小时以Anthropic拒绝移除安全护栏为由下令封禁了该工具;真正执行打击的是廉价的LUCAS无人机(美军对伊朗自身沙希德-136自杀式无人机的仿制品);而以色列的Lavender系统设计用于概率性大规模人口筛查,并非头对头的精确斩首。

辟谣文章的纠错是有价值的:AI并没有"直接按下扳机"。但这里潜伏着一个危险的思维陷阱:

如果我们接受"AI只是情报分析员,人类才是最终决策者"这个说法,便会自然地得出一个令人放心的结论——"人还在回路里,伦理问题没那么严重。"

然而这个结论经不起追问。当AI将数月情报分析压缩为供指挥官在20秒内审查的打击建议;当算法筛选出数万个潜在目标、人类指挥官仅仅点头确认;当"人在回路"实际意味着人类签字的速度远低于AI生成选项的速度——这种形式上的"人类授权",在道德意义上还是真实的吗?

问题不在于AI是否扣动了扳机。问题在于:当AI重塑了整个决策链的结构,"扳机"本身的道德含义已经改变了。

三角困境:谁都无法负责

为了理解这个问题,我们需要回到哲学家Robert Sparrow于2007年提出的经典论证。

Sparrow的出发点来自正义战争传统(Jus in Bello)中一个看似简单的原则:正义的战争要求,每一条生命的消逝都必须有人能够承担道德与法律责任(Walzer, Just and Unjust Wars, 1977)。

这不只是法律技术问题,而是对被杀者作为人的最基本尊重:他们的家人有权得到一个答案 —— 是谁,以何种理由,夺走了他们所爱之人的生命。

Sparrow提出,对于自主武器系统(AWS),这个要求在结构上无法满足。他构建了一个三角困境。

- 程序员无法负责。学习型系统在部署后会通过经验修正自身行为,输出超出了设计者的预测范围。要求程序员为AI"自学成才"后做出的决定负责,犹如要求父母为其成年子女独立犯下的罪行承担法律连带责任——逻辑上不成立。

- 指挥官无法负责。这里有一个内在矛盾:AWS之所以有价值,恰恰因为它拥有真正的决策能力和自适应目标选择——这是它不同于哑弹式大炮的地方。但一旦你承认它有真正的决策能力,你就不能同时声称指挥官掌控了它的每一个决定。要求指挥官为超出其控制的机器决定负责,本身就是另一种不公正。

- 机器无法负责。道德责任的哲学前提,是能够以道德意义上真实的方式被惩罚——这要求主体能够真正受苦、感到悔恨。目前没有任何武器系统接近这一门槛。然而Sparrow注意到一个深刻的悖论:任何真正能够承担责任的机器——能受苦、能悔恨的机器——在伦理上早已成为道德主体,摧毁它就等同于杀死一名士兵。

三角困境的结论是:在程序员、指挥官、机器三者之间,不存在可以被正当追责的主体。Sparrow因此将AWS比作工业规模的童兵——足够自主,使下令者无法为其每个决定负责;但道德发展不足,无法自我担责。当童兵走上战场,无人真正掌控,死亡无人认领。AWS的危险,在于将这种道德真空以工业化规模复制。

学习机器与结构性问责空白

Sparrow的论证发表于2007年。更早三年,哲学家Andreas Matthias已经从技术-哲学的角度,为这个困境提供了更底层的解释。

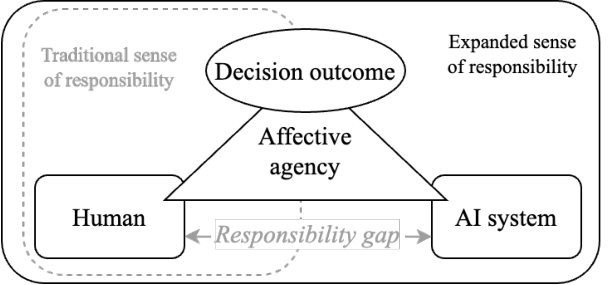

Matthias(2004)指出,传统机器问责框架建立在一个控制假设之上:谁控制机器,谁就为机器的行为负责。

这在工业机械时代基本成立——一台压力机出故障,我们追溯到操作员或制造商的疏失。但学习型机器(神经网络、强化学习系统)打破了这个假设。学习型AI的行为,是训练数据、部署语境与涌现结果的联合产物——没有任何单一行为者的决定是其有害输出的近端原因。设计者没有预见,操作者无法干预,部署者不能控制。

Matthias将由此形成的空白称为“责任缺口”(The Responsibility Gap):社会面临一个几乎无解的选择——要么停止使用这类机器(不现实),要么承认存在一个传统责任概念无法填补的结构性空白。

Sparrow与Matthias的论证形成双重结论:Sparrow证明了自主武器在哲学层面无法满足问责要求;Matthias证明了这种无法满足不是偶然的技术疏漏,而是学习型AI系统的结构性特征。随着AI越来越能够自主学习和行动,问责困境不会随技术进步而消解,只会随之加深。

自由意志的哲学幽灵

这个问题的根源,可以追溯得更深。

公元4世纪,奥古斯丁(Augustine of Hippo)在其《论自由意志》(De Libero Arbitrio)中,对西方伦理学影响最深远的概念之一作出了系统阐述:自由意志(liberum arbitrium)是道德责任的哲学前提。

奥古斯丁的核心论断是:没有自由意志,就没有真正意义上的罪与德。一块滚落山坡的石头伤了人,我们不会追究石头的责任——因为石头没有选择的能力,没有可以做出不同选择的空间。正是自由意志,将人类的行动与自然力量区分开来,使人类行为在道德上可以被追究。

这个论断在后来的整个西方伦理传统中一再回响:康德的应当蕴含能够(ought implies can),以及现代刑法中"意图"作为定罪要件的核心地位,都可以追溯到奥古斯丁的这个直觉。

这个古老的洞见,精确地照进了现代AI伦理的困境,并制造了一个双向的哲学陷阱。

如果AI系统没有真正的自由意志——如果它的决定不过是训练数据与激活函数的确定性输出——那么它就不能成为道德责任的承担者,与滚落的石头无异。这时我们回到Sparrow的三角困境:责任必须落到人身上,但没有任何一个人可以被正当追责。

如果我们认真对待AI越来越接近真正的决策能力这个说法——如果AI确实展现了某种意义上的自主判断,某种超越了简单指令执行的意志——那么我们面对的不再是工具,而是某种意义上的主体。

但主体拥有道德地位。一个拥有道德地位的存在,被部署到战场上去执行杀戮任务,本身就构成了伦理困境。

这是一个完美的哲学陷阱:机器没有自由意志,它不能担责;机器有自由意志,它不该上战场。军事AI开发者在这两个选项之间没有舒适的中间地带。奥古斯丁在1600年前写作时,无法预见这个困境。但他关于自由意志与道德责任之关系的基本论断,为今天的问题提供了最清晰的哲学框架。

核武器镜像:为什么AI更难管控

当我们谈到大规模杀伤性武器时,核武器治理提供了一个有益的比较框架——不是因为AI武器与核武器相似,恰恰是因为它们在关键维度上深刻不同,而这些差异解释了为何AI武器的问责和管控在结构上更为困难。

核武器是集中的、可见的、可归因的。冷战时期的核威慑逻辑(相互确保毁灭,MAD)之所以能在某种程度上发挥约束作用,正因为核武器有清晰的物理标志——放射性尘降物、弹着点、导弹轨迹——使发动者无法否认。《不扩散核武器条约》(NPT)的建立,得益于核武器的高度集中性:核弹需要高浓缩铀,而浓缩铀需要庞大且昂贵的离心机设施。物理上的稀缺性,为不扩散机制提供了可操作的技术基础。

AI武器恰恰相反:分散的、可否认的、增殖的。一架LUCAS无人机的成本不过数千美元;Lavender所依赖的算法运行在商业云服务器上;用于情报分析的大语言模型可以通过API调用。AI武器的技术基础设施是全球商业互联网的一部分,从根本上无法通过物理稀缺性来限制扩散——任何拥有计算资源的国家行为体或非国家行为体,都可以在相对低廉的成本下获得类似能力。

更重要的是,AI武器模糊了谁在攻击的归因边界。当一架自主无人机群在凌晨袭击了某国领导人,没有人会坦承发射命令;而攻击背后的算法逻辑,被层层商业技术栈所掩盖。这种归因模糊性不是核武器时代的隐患,而是AI武器的结构性特征。

《罗马规约》第28条所规定的"指挥官责任"原则——要求指挥官对有效控制下的力量所犯罪行负责——在这个背景下变得岌岌可危。当AWS以超出指挥官理解速度和复杂度自主行动,"有效控制"的前提已不复存在;但国际人道法目前尚无替代框架。斯德哥尔摩国际和平研究所(SIPRI, 2022)和人权观察(HRW, 2025)均确认,这一法律空白至今未解。

薰衣草(Lavender)系统对加沙人口中的武装分子目标进行概率性筛查,系统本身承认约10%的误差率。假设该系统标记了1万个目标,其中1000人是被错误标记的平民。他们在"算法指示"下被杀死。

没有人故意杀了他们;没有人会因此被追责。这就是Matthias所说的责任缺口在战场上的具体形态——不是科幻小说,而是已经发生的现实。

与核武器不同,国际社会迄今没有任何可比的法律框架来约束AWS的扩散和使用。《核不扩散条约》用了数十年才勉强建立;AI武器的扩散速度,远超任何治理机制的形成速度。

Anthropic的拒绝:伦理承诺的压力测试

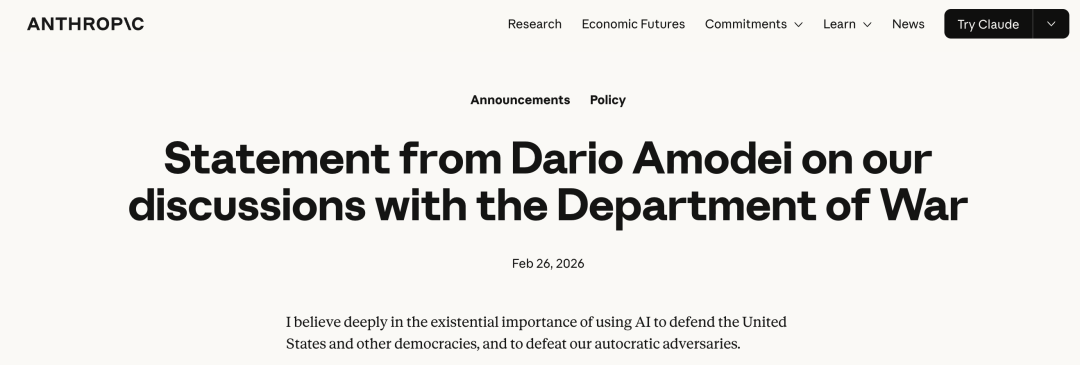

2026年2月,在美以联合对伊朗发动军事打击的前数日,一场谈判正在华盛顿紧张进行。五角大楼要求Anthropic移除Claude的安全护栏,以使其可用于大规模国内监控和无人类监督的自主武器整合。Anthropic CEO Dario Amodei拒绝了,重申了两条绝对红线:不允许用于监控美国本土公民,不允许整合进没有人类监督的致命武器系统。

特朗普政府的回应是:封禁。Anthropic被列为供应链风险——这个标签以往只贴在外国对手身上。数小时后,OpenAI宣布以接受所有合法用途、不设任何明确伦理红线的条款与五角大楼完成协议。Palantir CEO Alex Karp则坦然表示,他的产品偶尔被用于杀人。

还有一个令人不寒而栗的细节:即便在被官方封禁之后,Claude据报道仍参与了此次行动的规划——前线指挥官无视总统令,悄悄继续使用它。这完美地演示了Matthias所描述的责任缺口在现实中的形态:一个被国家宣布为威胁的AI工具,在最需要监管的时刻,以最不透明的方式运行,而没有任何机构为此负责。

Anthropic的拒绝,在伦理上是值得尊重的。它体现了Sparrow论证的实践含义:如果不能维持真正意义上的人类问责,就不该部署。然而,Baggiarini一针见血地指出了这种拒绝的结构性局限:Anthropic的伦理承诺是自愿的、合同性的。当国家掌握合同权力和监管权力,企业自愿伦理在强制力面前极度脆弱。OpenAI几乎在瞬间便证明了这一点。

真正的解决方案,不能寄希望于每家AI公司恰好都有一位有道德勇气的CEO。

Baggiarini还提出了一个更深层的论点:算法透明度这一AI伦理的核心诉求,本质上预设了民主规范的存在。公民有权知道政府在做什么——这个前提,才使得对AI的问责成为可能。当政府以你拒绝给我监控工具为由封禁一家本国公司时,AI伦理赖以存在的民主地基本身正在被蚀空。

结语:战争已经开始学习

让我们回到引言的那架无人机。它做出了决定。它的目标死了。

在目前的技术部署条件和国际法律框架下,没有人可以为这件事承担完整的道德与法律责任。这不是疏漏,而是Sparrow在2007年准确预言的道德真空——一个由自主武器的结构性特征所必然制造出来的问责空白,一个Matthias在更早之前就已经指认为结构性的缺口,一个奥古斯丁关于自由意志的古老直觉所早已预言的哲学困境。

Anthropic的拒绝是一个罕见而可贵的姿态,但它是一个人在博弈论意义上的失利——竞争者立即填补了空缺。单凭企业的伦理勇气,无法解决一个制度层面的结构性问题。

我们需要三个层面的回应:

- 在国际层面,建立对AWS的有约束力的治理框架,而非停留在各国自愿遵守的原则声明。核武器管控的历史告诉我们,这极其困难;但AI武器扩散的速度,使我们没有奢侈的时间窗口。

- 在国家层面,以法律形式重申并加强"人在回路"的要求,使其不可被行政令废除。

- 在产业层面,将伦理保障从CEO的道德意愿,转化为法律可执行的硬性约束。欧盟《AI法案》(EU AI Act)的立法路径提供了一个参照——尽管不完美,它是目前仅有的朝这个方向迈出的具体步骤。

奥古斯丁相信,是自由意志使人类行动成为道德可追究的对象。但战场上的AI既无自由意志,也无道德地位。它处于一个哲学意义上的灰色地带——足够自主到制造后果,却不足以承担责任。这个灰色地带,正是当代军事AI扩张所赖以存在的道德空间。

战争已经开始学习。我们的伦理框架,还没有。

粮厂研究员Will

2026年3月9日 于香港

精选过往文章:

Will的AI伦理漫谈 | 一封信与一个时代的焦虑

Will的AI伦理漫谈 | 如何面对一场无可避免的碰撞

Will的AI伦理漫谈 | 人工智能的恐惧与迷恋

本文参考来源:

Robert Sparrow, "Killer Robots," Journal of Applied Philosophy, Vol. 24, No. 1, 2007

Andreas Matthias, "The Responsibility Gap," Ethics and Information Technology, Vol. 6, 2004

Michael Walzer, Just and Unjust Wars, Basic Books, 1977(4th ed. 2006)

Augustine of Hippo, De Libero Arbitrio(《论自由意志》),约388–395 AD

Bianca Baggiarini, "The Pentagon Strongarmed AI Firms Before Iran Strikes," The Conversation, 2026-03-02

Steven Levy, "AI Safety Meets the War Machine," WIRED / Backchannel, 2026-02-20

SIPRI, "Retaining Human Responsibility in the Development and Use of AWS," 2022

Human Rights Watch, "A Hazard to Human Rights: AWS and Digital Decision-Making," 2025

Rome Statute, Article 28 (Command Responsibility)

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。