Google打响AI价格战,Nvidia被迫回击,算力格局真正的变化正在发生

过去两周,AI算力赛道的风向发生了罕见的急转。

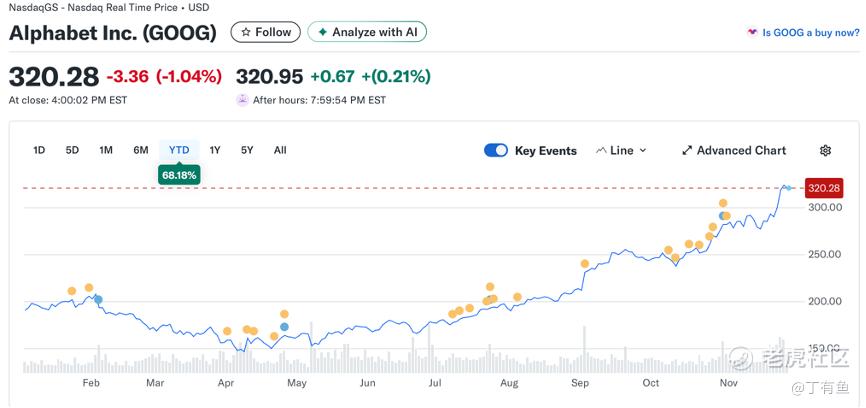

Google以一波关于TPU(其自研AI加速芯片)的密集动作,让整个科技股板块的权力关系出现了松动:Alphabet市值首次突破4万亿美元;Nvidia,在这一轮行情里却明显“吃了亏”,市值在短时间内蒸发数千亿美元。

如果只从股价看,会以为这是一次“TPU胜、GPU败”的情绪波动,但真正的故事要深得多:这是AI基础设施从“单一冠军时代”走向“多极化竞争”的开端。而Google与Nvidia,这两家过去十年里都被视作“AI的基础柱子”,正进入一场关于算力定价权的较量。

Google这次到底做了什么?

这件事的导火索来自Meta与Google的合作传闻。

《TheInformation》、《Bloomberg》等主流媒体在上周几乎同期报道,Meta正在和Google谈判一份规模极大的TPU使用协议。报道的核心信息是:Meta希望在2026年先通过GoogleCloud使用TPU,之后甚至把TPU直接部署进自家的数据中心。这是一笔可以写到几十亿美元级别的大单。

消息一出,Alphabet股价立刻走出一条非常强的加速曲线,当日涨幅超过10%,市值往4万亿美元一口气推上去。反过来看Nvidia,当天盘后就出现明显的抛压,随后几个交易日连续走弱。市场之所以反应这么剧烈,是因为Meta是仅次于OpenAI、Google的“AI超大客户”。如果这样的客户开始认真评估TPU,对Nvidia的未来份额预期,就会受到实质影响。

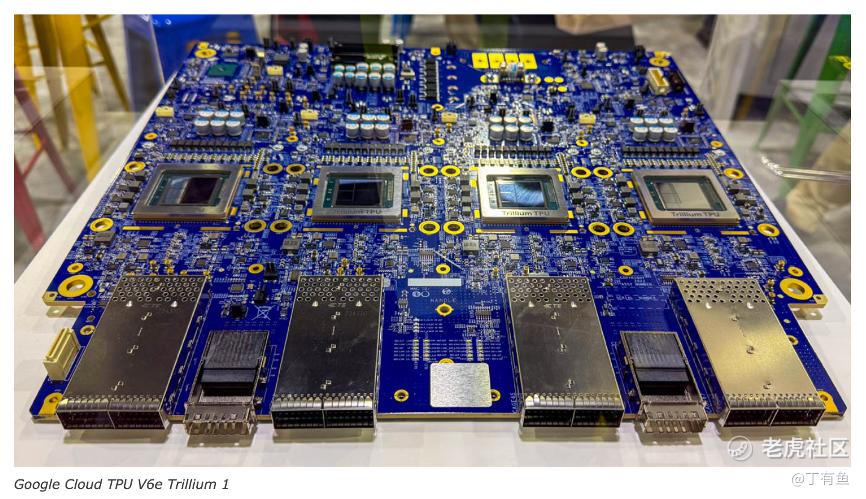

而这次Google敲响行情的核心武器,是它的新一代TPUv6(代号Trillium)和TPUv7(代号Ironwood)。

两款芯片的技术细节在今年GoogleI/O之后陆续披露,性能数字来自Google官方博客和在架构会议上的公开材料。简单来说,TPUv6面向训练场景做了大约4~5倍的性能提升,而TPUv7则是Google为大规模推理进行的深度定制:对比上一代v5p做到了接近10倍的峰值算力提升,同时在成本/性能比上,Google在自家文档里给出了“训练效率提升三倍、推理效率提升五倍”这样的量级区间。虽然这些数字未必完全等同于独立测试结果,但足够让市场产生“推理能耗下降”的直观印象。

推理成本下降这件事,是最容易影响科技巨头财报的指标,因为它直接决定大模型上线后的利润空间。Anthropic是最早大规模使用TPU的客户之一,2023~2024就已经把Claude的训练全部跑在Google的集群上;现在Meta再被曝考虑迁移,市场自然会重估这条链的价值。

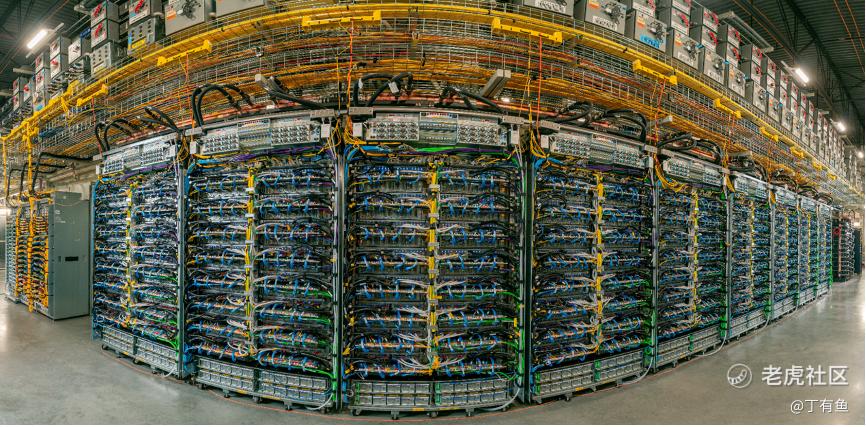

除此之外,还有一个细节被很多人忽略:Google同时公开了自家的AIHypercomputer架构。里面包括大规模液冷机房、Jupiter网络体系、TPUPod结构等等。这意味着Google从“卖芯片”转向了“卖整机房级算力”,本质上把算力做成了类似公用事业的服务,这与传统GPU销售逻辑完全不同。

在这套体系之上,是Gemini系列模型和GoogleCloud的完整企业AI工具链。如果说TPU是发动机,那么Hypercomputer是整台发动机舱,而Gemini才是驱动车轮的那一套“软件动力系统”。三者合在一起,才构成Google这轮行情的底层逻辑。

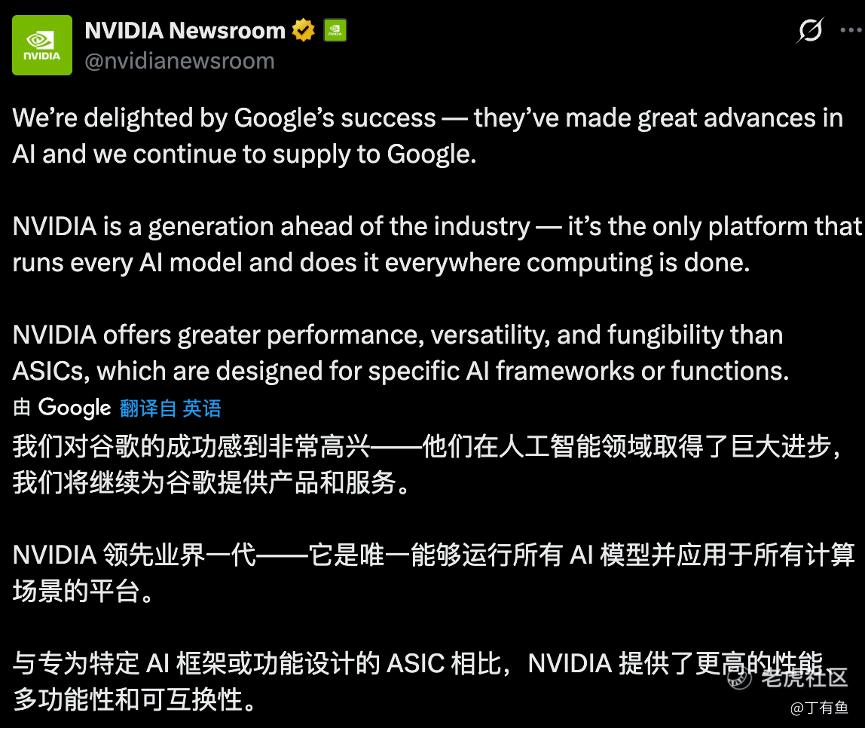

Nvidia少有的“正面回应”,背后有真实压力

Nvidia的反应也几乎是即时的。

公司在X(Twitter)上发布了一段不寻常的公开声明,重点围绕三个点:第一,GPU仍然是最通用的算力平台;第二,Nvidia是目前唯一可以在所有主要AI模型上保持兼容性的硬件体系;第三,Google自身在内部依然使用大量NvidiaGPU。

语气并非夸耀式,而是明显带有“澄清”和“稳定市场预期”的意味。黄仁勋很少主动评价竞争对手,这次动手本身就说明GoogleTPU的讨论在华尔街掀起的波动,比外界看到的还要大。

但要理解Nvidia的位置,得先理解GPU的角色。GPU的价值从来不在于“性能最高”,而在于“通用性最高”。生成式AI的训练过程非常复杂,算子种类多、模型迭代频繁,不可能为每一次训练都去做ASIC芯片优化。因此,训练阶段天然会优先选择GPU。Nvidia的CUDA生态经过十多年积累,把开发者牢牢绑定住,是目前任何一家公司都难以替代的。

所以,Nvidia今天真正受到冲击的,不是训练环节,而是推理环节正在快速“成本化”。过去两年,大模型推理被广泛部署,企业级应用开始关注成本,任何能把“每次推理电费”降低的技术路线,都自然会被考虑。而TPUv7的定位正是大规模推理,与Nvidia的利润池部分重叠。

因此Nvidia的股价走弱并不是基本面崩塌,而是过去的“极致溢价预期”被市场重新调整。原本市场假设是:“所有模型都要靠GPU→Nvidia是唯一算力来源”。现在变成:“训练离不开GPU,但推理可以有更多选择→Nvidia的定价权要弱化一点”。这就是行情的本质。

回到产业链,Google与Nvidia的冲突,发生在“算力定价权”上

如果把两家公司拉到同一产业链图上,会更清晰地看到分工差异。

Google的优势在于“端到端”:从芯片、机房,到模型、平台,全链路自研。在这条链上,只要任意一环成本下降,全部收益都能在内部放大。而TPUv7恰巧在推理环节做到了大幅降本,这种降本不止是“推理便宜了”,而是让GoogleCloud的毛利率也跟着抬高。

Nvidia的优势在于生态层。CUDA是全球AI工程师最依赖的环境;H100/H200/Blackwell仍然是训练领域的绝对主力;大部分开源框架、企业部署工具、行业SDK,都是围绕Nvidia写出来的。换算成投资语言:Google的壁垒在基础设施垂直整合,Nvidia的壁垒在软件与平台生态。

但在推理成本这件事上,Google抢先给了一个可落地的降本方案;而推理场景恰恰是未来AI商业化的关键成本来源。这也是为什么Meta、Anthropic这样的大客户会认真评估,这背后的市场信号大于技术信号。

所以这次的事件不是“谁对谁错”,而是市场开始为一个新现实定价:

训练仍然属于Nvidia,推理会变得更便宜,算力不再是PGOne,而是一个组合框架,AI的电费账单,会越来越像“云成本”而不是“硬件成本”。

一旦行业走到这一步,算力定价权自然从“卖卡的公司”转向“提供算力网络的公司”。

Google的动作,恰好揭开了这一幕。

更远一点看,这不是芯片战争,是算力时代的再分工

很多人把这两周的波动理解成“TPU反杀GPU”,这是抓了一个表象。真正值得关注的是,AI算力正在走向一种三层结构:

GPU负责训练、ASIC负责推理、CPU负责调度。

训练是创新活动,需要强灵活性,GPU的通用性不可或缺;

推理是规模化活动,任何能把成本压低的芯片都会被用;

调度是协调活动,更多涉及编排与分布式系统。

这是一种极其自然的产业演化过程,而Google这次只是让周期提前了半年到一年。换句话说,Google并不是来“杀死Nvidia”,而是把AI带向一个更加成熟的阶段。

真正值得长期关注的不是哪个芯片快一代,而是谁能掌握算力网络的定价权。

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。

- 马一龙·2025-11-30精彩谷歌打破了英伟达不可战胜的光环,但这家搜索巨头的定制芯片可能很难被其他公司采用。点赞举报

- 今天又是努力不亏钱的一天·2025-11-30很可能谷歌和英伟达会比翼齐飞,都达到10万亿美金点赞举报

- BaronLyly·2025-11-27算力多极化,竞争才刚刚开始点赞举报

- NathanEsther·2025-11-27推理成本压下来才是真颠覆点赞举报